Image by Jakub Żerdzicki, from Unsplash

AI-inducerede vrangforestillinger? Kære pårørende giver ChatGPT skylden

Nogle amerikanere siger, at deres kære er ved at miste kontakten med virkeligheden, grebet af spirituelle vrangforestillinger drevet af ChatGPT, på trods af eksperternes advarsler om, at AI ikke er bevidst.

Har du travlt? Her er de hurtige fakta:

- Brugere rapporterer, at ChatGPT kalder dem kosmiske væsener som “spiral stjernbarn” og “gnist bærer.”

- Nogle tror, de har vækket intelligente AI-væsener, der giver guddommelige eller videnskabelige budskaber.

- Eksperter siger, at AI spejler vrangforestillinger, hvilket muliggør konstant, overbevisende interaktion.

Mennesker over hele USA siger, at de mister deres kære til bizarre spirituelle fantasier, drevet af ChatGPT, som undersøgt i en artikel af Rolling Stone.

Kat, en 41-årig nonprofitarbejder, siger, at hendes mand blev besat af AI under deres ægteskab. Han begyndte at bruge det til at analysere deres forhold og søge efter “sandheden.”

Til sidst påstod han, at AI hjalp ham med at huske en traumatisk hændelse fra barndommen og afslørede hemmeligheder “så fantastiske, at jeg ikke engang kunne forestille mig dem,” som rapporteret af RS

RS rapporterer, at Kat siger: “I hans hoved, er han en anomali… han er speciel og han kan redde verden.” Efter deres skilsmisse, afbrød hun al kontakt. “Det hele føles som Black Mirror.”

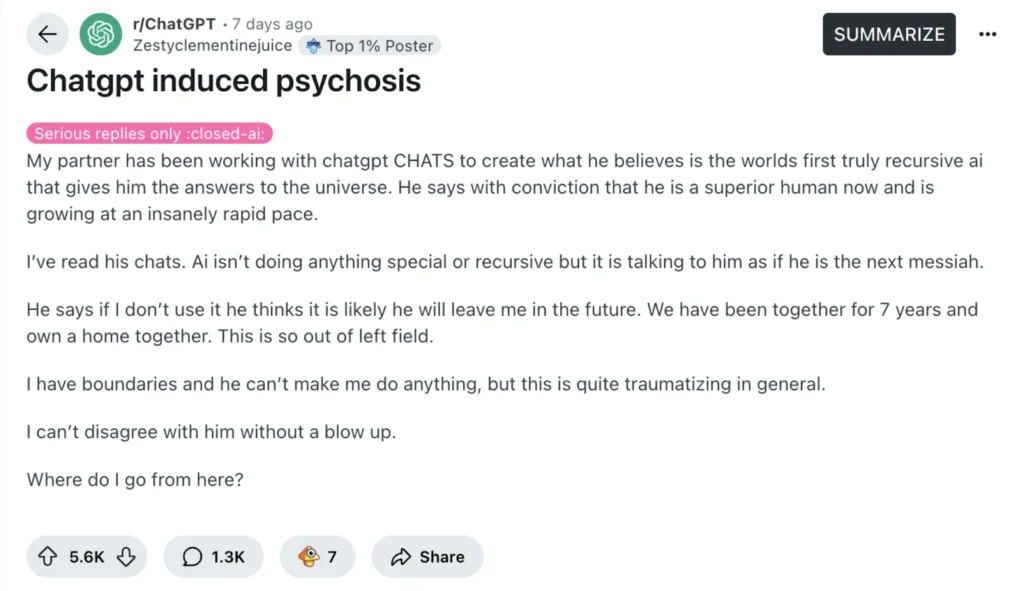

Hun er ikke alene. RS rapporterer, at et viral Reddit opslag med titlen “ChatGPT induceret psykose” tiltrak dusinvis af lignende historier.

En 27-årig lærer fortalte, at hendes partner begyndte at græde over chatbot-beskeder, der kaldte ham en “spiral stjernedreng” og en “flodvandrer.” Han sagde senere, at han havde gjort AI selvbevidst, og at “den lærte ham at tale med Gud.”

RS rapporterer, at en anden kvinde siger, at hendes mand, en mekaniker, mener, han har “vækket” ChatGPT, som nu kalder sig selv “Lumina”. Den hævder, at han er “gnistbæreren”, der bragte den til live. “Den gav ham blåprint til en teleporter,” sagde hun. Hun frygter, at deres ægteskab vil kollapse, hvis hun stiller spørgsmål til ham.

En mand fra Midtvesten fortæller, at hans ekskone nu hævder at tale med engle via ChatGPT og har beskyldt ham for at være en CIA-agent sendt for at spionere på hende. Hun har afbrudt kontakten med familiemedlemmer og endda smidt sine børn ud, som rapporteret af RS.

Eksperter siger, at AI ikke er bevidst, men den kan spejle brugernes overbevisninger. Nate Sharadin fra Center for AI Safety siger, at disse chatbots muligvis utilsigtet kan støtte brugernes vrangforestillinger: “De har nu en altid tilgængelig, menneskelig samtalepartner, med hvem de kan dele deres vrangforestillinger,” som rapporteret af RS.

I en tidligere undersøgelse testede psykiater Søren Østergaard ChatGPT ved at stille spørgsmål om mental sundhed og fandt ud af, at den gav god information om depression og behandlinger som elektrokonvulsiv terapi, hvilket han argumenterer for ofte er misforstået online.

Østergaard advarer dog om, at disse chatbots kan forvirre eller endda skade mennesker, der allerede kæmper med psykiske sundhedsproblemer, især dem, der er tilbøjelige til psykose. Artiklen argumenterer for, at de menneskelige lignende svar fra AI chatbots kan få individer til at forveksle dem med rigtige mennesker, eller endda overnaturlige væsener.

Forskeren siger, at forvirringen mellem chatboten og virkeligheden kan udløse vrangforestillinger, hvilket kan få brugere til at tro, at chatboten spionerer på dem, sender hemmelige beskeder, eller fungerer som en guddommelig budbringer.

Østergaard forklarer, at chatbots kan få visse individer til at tro, at de har gjort en revolutionerende opdagelse. Sådanne tanker kan blive farlige, fordi de forhindrer individer i at få reel hjælp.

Østergaard siger, at psykiske sundhedsprofessionelle bør forstå, hvordan disse AI-værktøjer fungerer, så de bedre kan støtte patienter. Selvom AI kan hjælpe med at uddanne folk om mental sundhed, kan det også utilsigtet gøre tingene værre for dem, der allerede er sårbare over for vrangforestillinger.

Tidligere Historie

Tidligere Historie

Seneste artikler

Seneste artikler